La IA puede escribir código, pero las habilidades lo protegen.

Nuestra plataforma de codificación segura para empresas le permite adquirir las habilidades necesarias para proteger tanto el código generado por humanos como el generado por IA sin retrasar la distribución.

La IA acelera el código. Las habilidades de codificación segura deben estar a la altura.

El asistente de codificación con IA puede generar código que se puede utilizar inmediatamente en entornos de producción. Sin embargo, la velocidad no es equivalente a la seguridad.

従来のセキュリティトレーニングは次のことに重点を置いています —機能ではありません。スタティックスキャンは問題が発生した後に問題を検出します。 ソフトウェアリスクを軽減するには、安全なコーディング動作を改善する必要がある 安全なコーディング機能は、効果的なAIソフトウェアガバナンスの基盤です。

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

Desarrollar capacidades de codificación segura a gran escala.

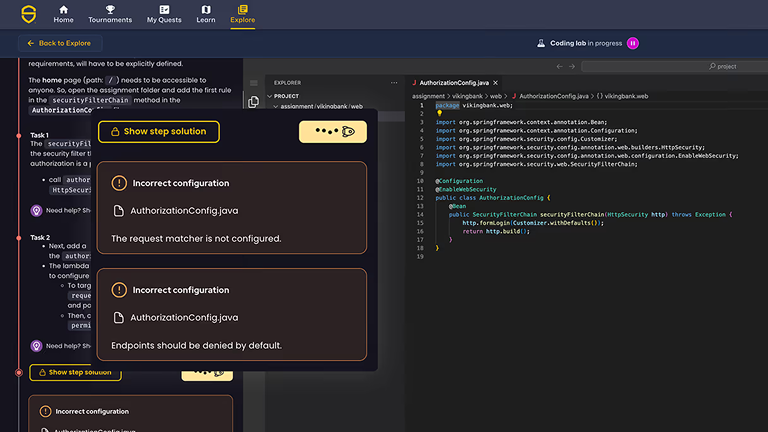

Laboratorio práctico de codificación segura

Los desarrolladores resuelven vulnerabilidades reales a través de ejercicios interactivos que abarcan más de 75 lenguajes y marcos de trabajo.

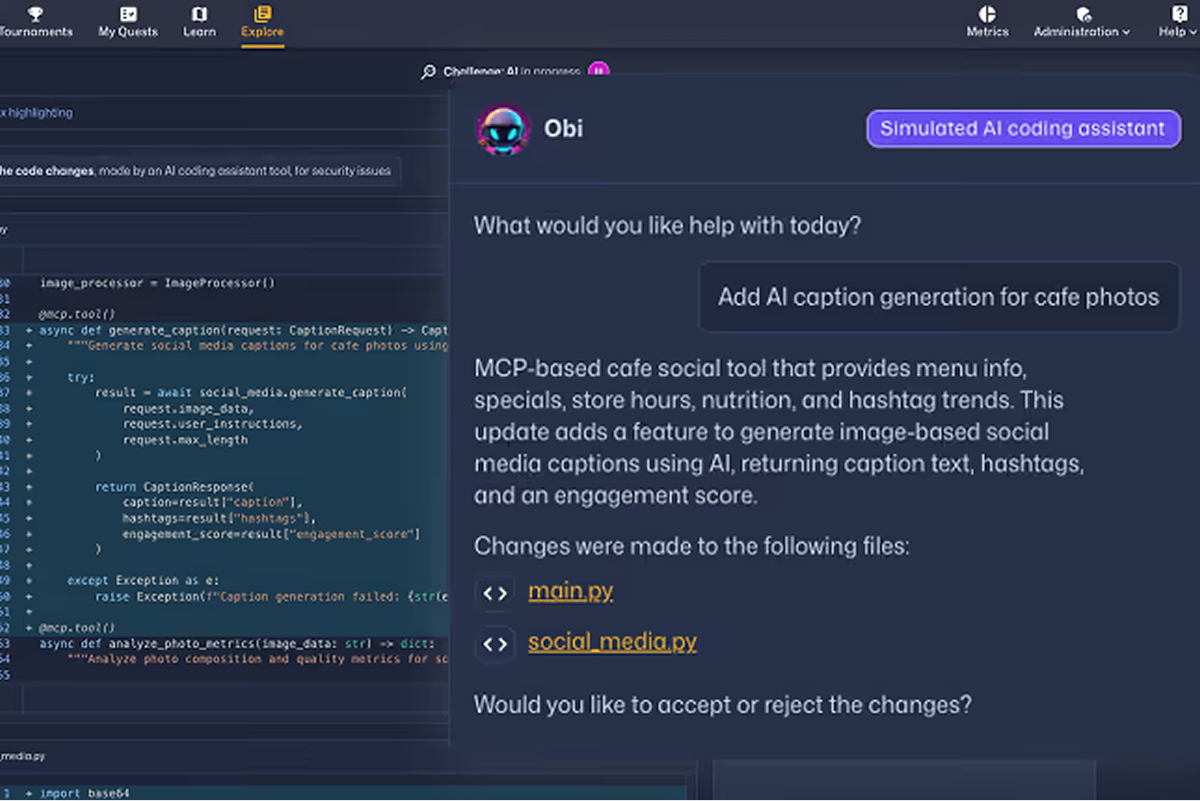

Módulo de seguridad inherente a la IA

Verifica y protege el código generado por IA, detecta patrones inseguros y aplica estándares de seguridad a los flujos de trabajo asistidos por IA.

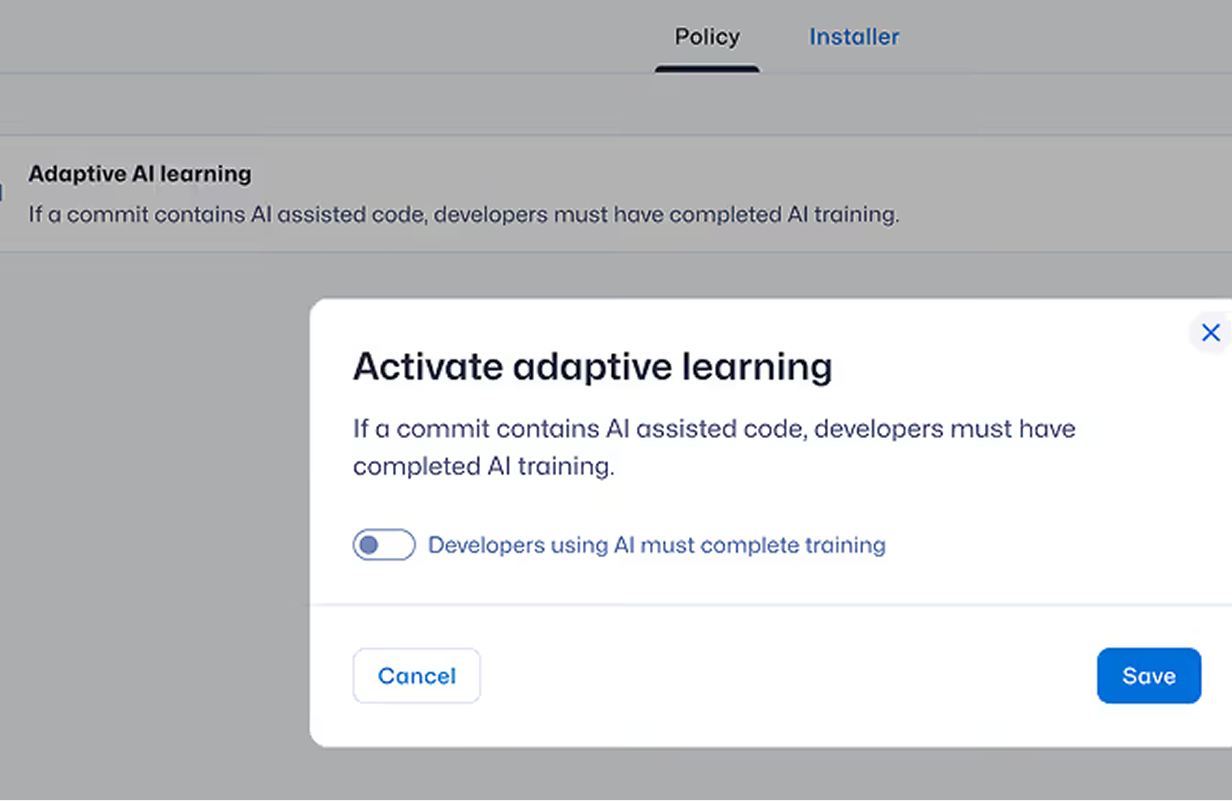

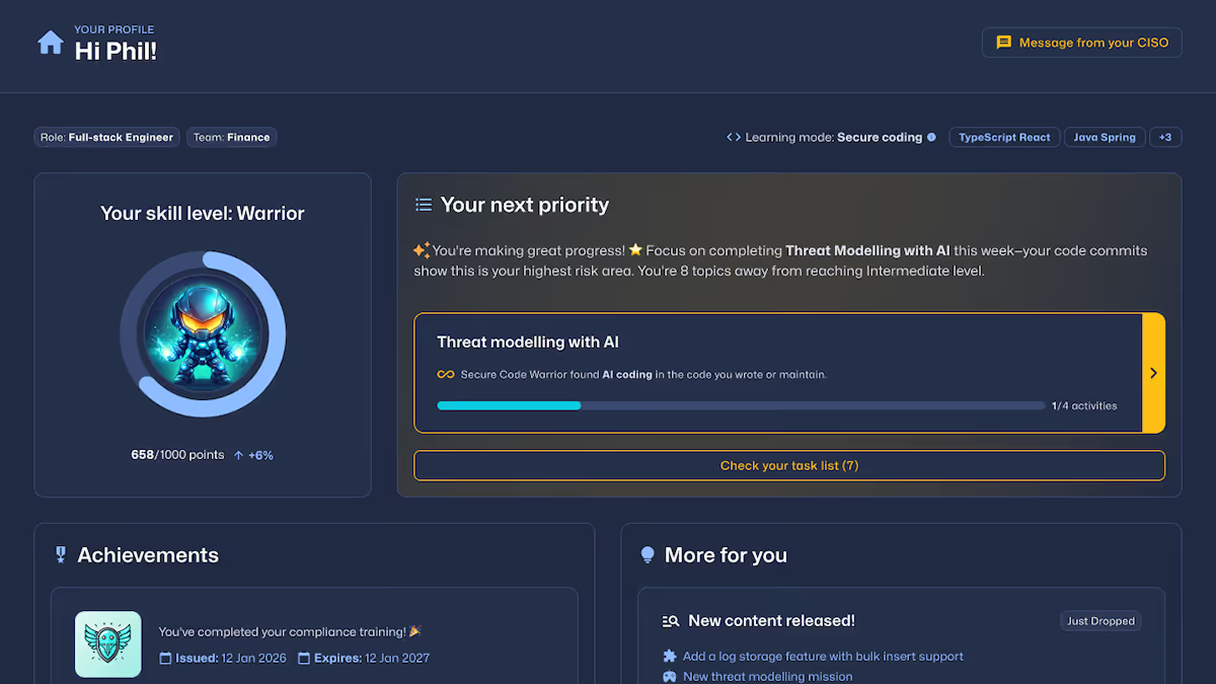

Ruta de aprendizaje adaptativa

Asignamos automáticamente formación específica basada en el comportamiento de los desarrolladores, las señales de riesgo de compromiso y las diferencias con respecto a los puntos de referencia.

Medir el progreso

SCW Trust Score® permite evaluar el nivel de competencia de los desarrolladores, compararlos con otros desarrolladores del sector y realizar un seguimiento cuantificable del progreso en materia de codificación segura.

Cumplimiento normativo

Se pueden crear informes que cumplan con los requisitos de auditoría y adaptar la formación a OWASP Top 10, NIST, PCI DSS, CRA y NIS2.

AI 主導開発のコントロールプレーン

AI 主導の開発を可視化、安全、回復力を持たせ、本番稼働前に脆弱性を防ぎ、チームが自信を持って迅速に行動できるようにします。

Misiones

Laboratorios de codificación

AI Challenges

Lorem ipsum dolor sit amet, consectetur adipiscing elit. Suspendisse varius enim in eros elementum tristique. Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat. Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet. Nunc ut sem vitae risus tristique posuere.

Missions

Reducir la vulnerabilidad desde su origen.

Secure Code Warrior reduce las vulnerabilidades recurrentes, refuerza los hábitos de codificación segura y permite a los desarrolladores demostrar mejoras cuantificables. Estos resultados muestran el impacto cuantificable que tiene la formación en codificación segura de las empresas cuando se implementa a gran escala en todo el entorno de desarrollo moderno.

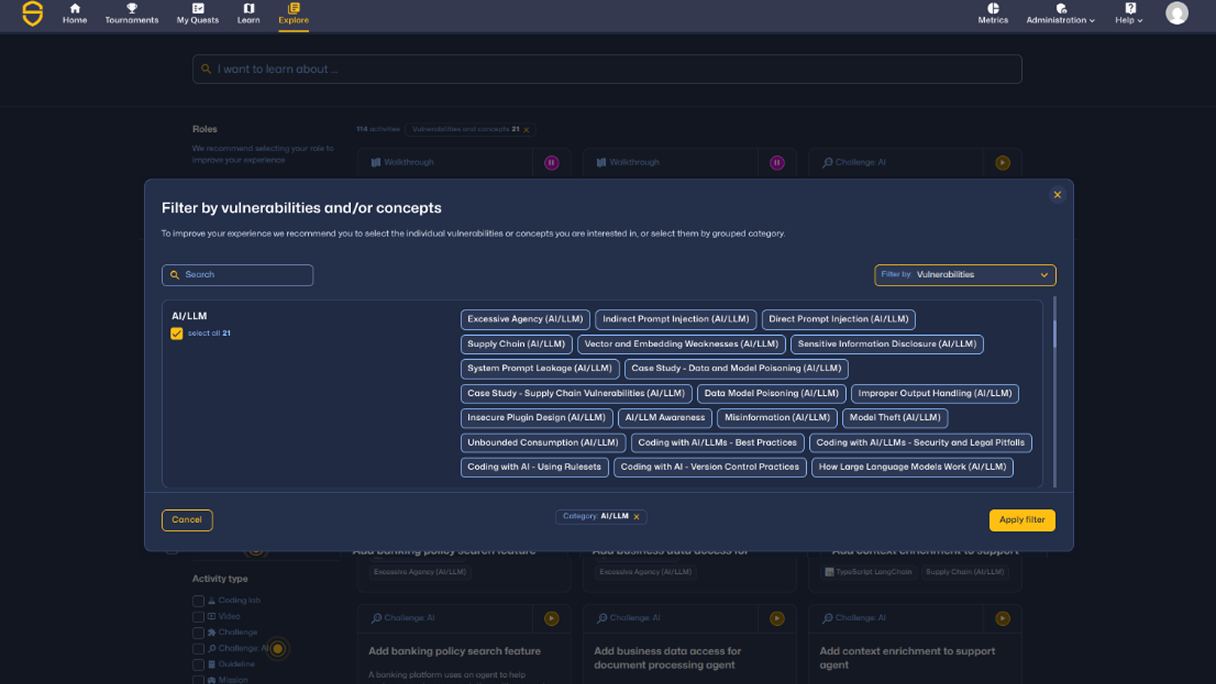

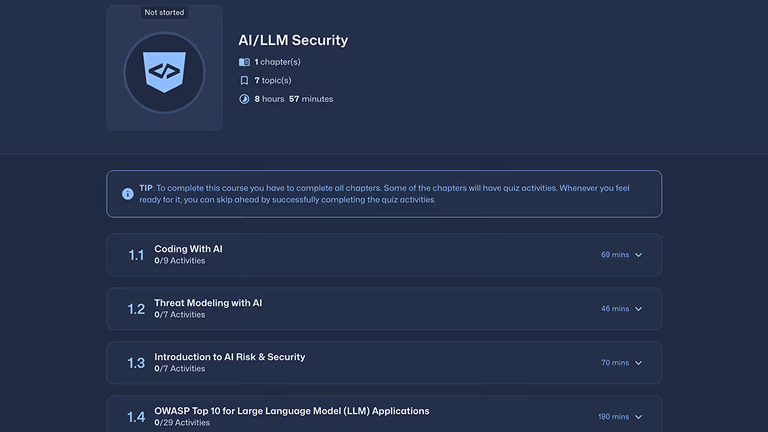

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

Diseñado específicamente para el equipo de gobernanza de IA

Demuestra competencias de desarrollo medibles y reduce los riesgos de software en el desarrollo humano y el desarrollo asistido por IA.

El código seguro comienza con desarrolladores seguros.

Fortalezca sus habilidades de codificación segura, reduzca las vulnerabilidades introducidas y genere confianza medible en los desarrolladores en toda la organización.

Reducir las vulnerabilidades mediante el aprendizaje práctico de la codificación segura.

Descubra cómo Secure Code Warrior mejora las habilidades de seguridad de los desarrolladores, reduce las vulnerabilidades y logra una reducción cuantificable del riesgo.