SCW Trust Agent: AI - Visibilidad y gobernanza para su SDLC asistido por IA

La adopción generalizada de herramientas de codificación de IA está transformando el desarrollo de software. El 78 % de los desarrolladores1 utilizan ya la IA para aumentar la productividad, por lo que la velocidad de la innovación nunca ha sido mayor. Pero esta rápida aceleración conlleva un riesgo crítico.

Los estudios revelan que hasta el 50% del código funcionalmente correcto generado por IA es inseguro2. No se trata de un pequeño fallo, sino de un reto sistémico. Significa que cada vez que un desarrollador utiliza una herramienta como GitHub Copilot o ChatGPT, podría estar introduciendo sin saberlo nuevas vulnerabilidades en su código base. El resultado es una peligrosa mezcla de velocidad y riesgos de seguridad que la mayoría de las organizaciones no están preparadas para gestionar.

El reto de la "IA en la sombra

Sin una forma de gestionar el uso de herramientas de codificación de IA, los responsables de CISO, AppSec e ingeniería están expuestos a nuevos riesgos que no pueden ver ni medir. Cómo puede responder a preguntas cruciales como:

- ¿Qué porcentaje de nuestro código está generado por IA?

- ¿Qué MCP se están utilizando?

- ¿Qué modelos no aprobados se están utilizando?

- ¿Qué vulnerabilidades generan los distintos modelos?

La falta de visibilidad y gobernanza crea una nueva capa de riesgo e incertidumbre. Es la definición misma de "TI en la sombra", pero para su código base.

Nuestra solución - Trust Agent: AI

Creemos que se puede tener velocidad y seguridad a la vez. Estamos orgullosos de lanzar Trust Agent: AIuna nueva y potente capacidad de nuestro producto Trust Agent que proporciona la capacidad de observación y el control que necesita para adoptar con confianza la IA en su ciclo de vida de desarrollo de software. Mediante una combinación única de señales, Trust Agent: AI proporciona:

- Visibilidad: Vea qué desarrolladores están utilizando qué herramientas de codificación de IA, LLM y MCP, y en qué bases de código. Se acabó la «IA en la sombra».

- Métricas de riesgo: Conecte el código generado por IA con el nivel de conocimientos de un desarrollador y las vulnerabilidades introducidas para comprender el verdadero riesgo que se está introduciendo, a nivel de commit.

- Gobernanza: Automatice la aplicación de políticas para garantizar que los desarrolladores habilitados para IA cumplan las normas de codificación segura.

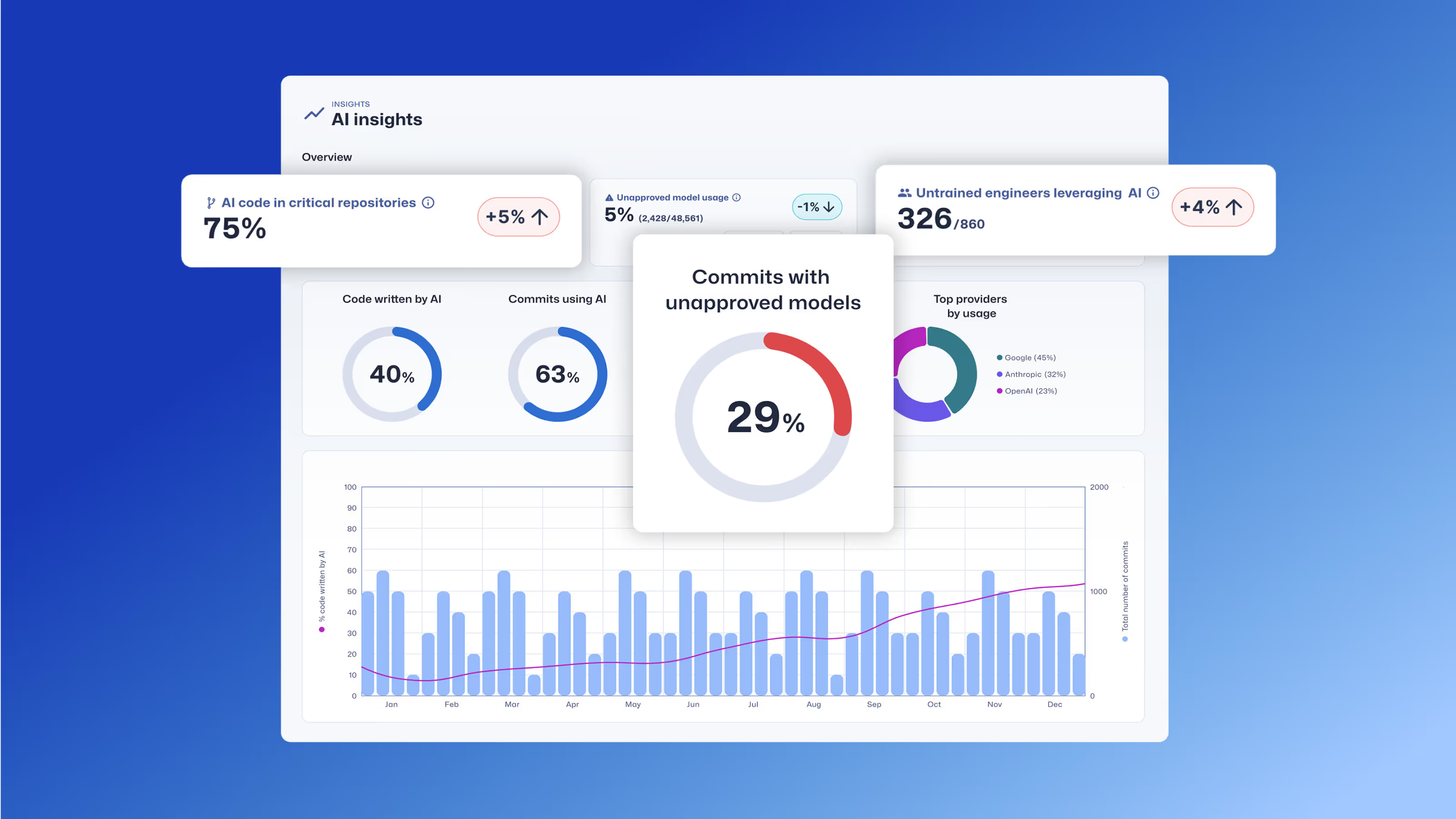

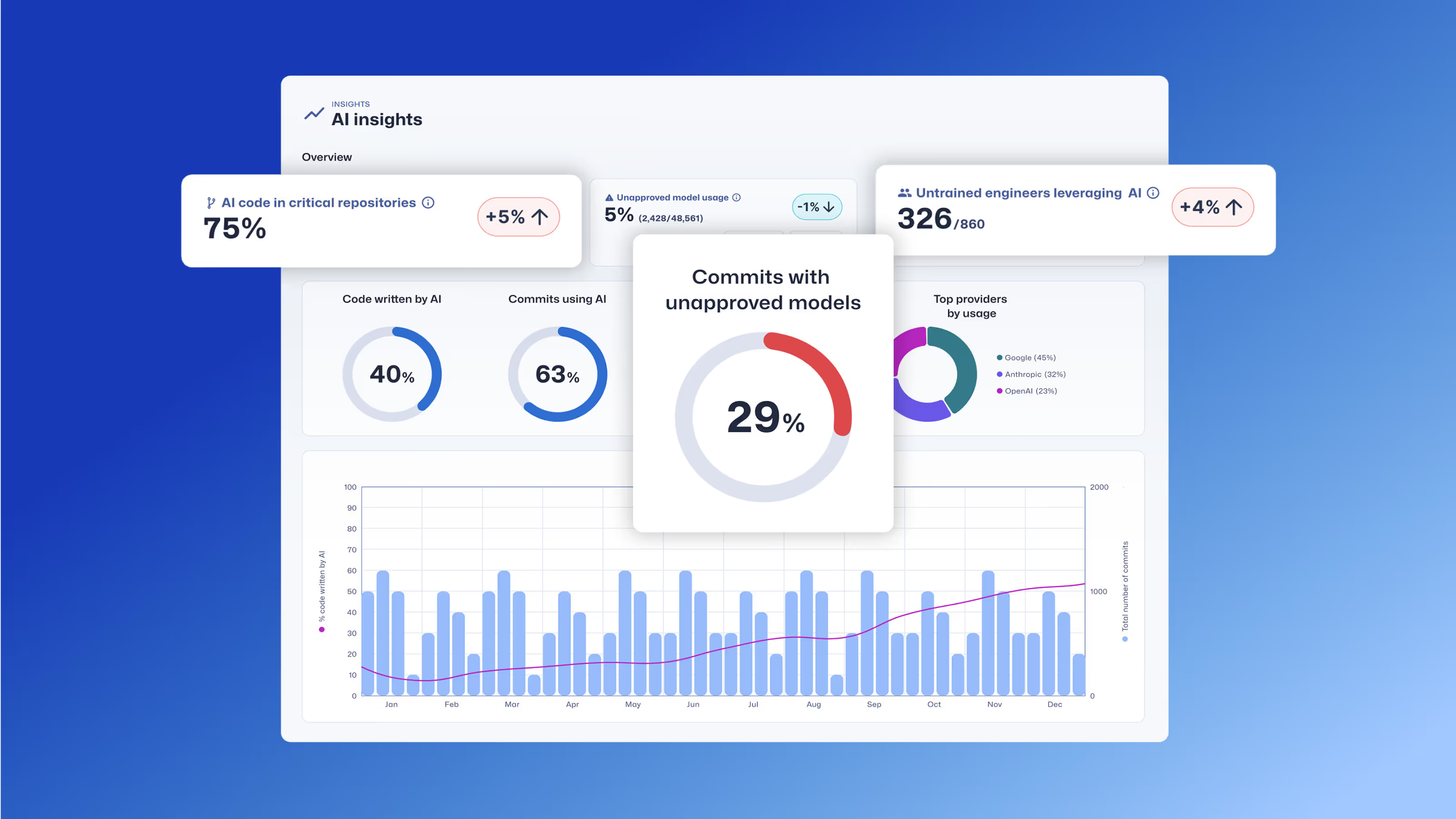

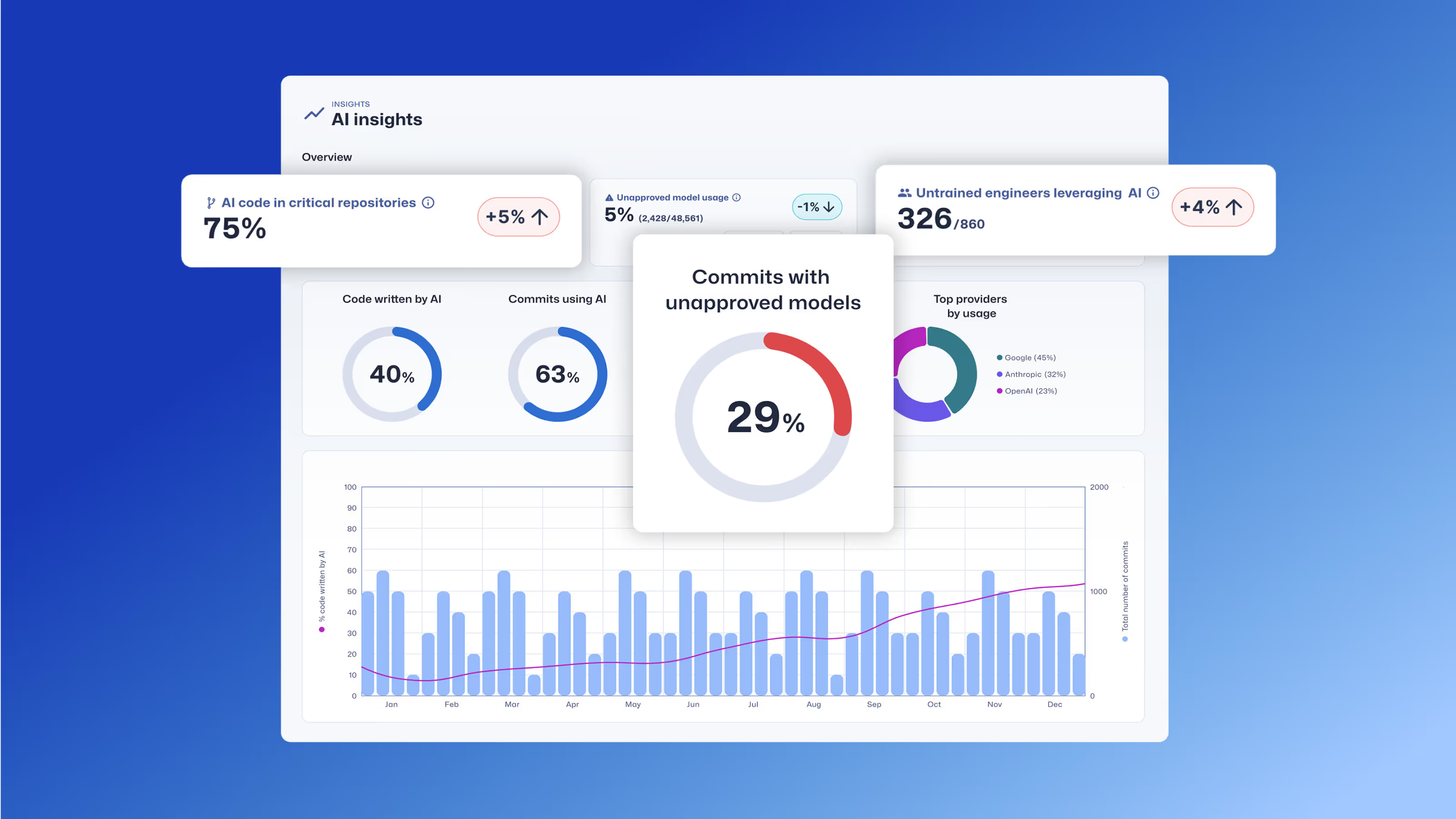

El panel Trust Agent: AI proporciona información sobre el uso de la herramienta de codificación de IA, el desarrollador que contribuye, el repositorio de código y mucho más.

El papel del desarrollador: La última línea de defensa

Aunque Trust Agent: AI le ofrece una gobernanza sin precedentes, sabemos que el desarrollador sigue siendo la última y más crítica línea de defensa. La forma más eficaz de gestionar el riesgo del código generado por IA es asegurarse de que sus desarrolladores cuentan con los conocimientos de seguridad necesarios para revisar, validar y proteger dicho código. Aquí es donde entra en juego SCW Learning, que forma parte de nuestra plataforma integral de gestión de riesgos para desarrolladores. Con SCW Learning, equipamos a sus desarrolladores con las habilidades prácticas que necesitan para aprovechar de forma segura la IA para la productividad. El producto SCW Learning incluye:

- Puntuación de confianza SCW: Una referencia pionera en el sector que cuantifica la competencia en seguridad de los desarrolladores, lo que le permite identificar qué desarrolladores están mejor equipados para manejar código generado por IA.

- Desafíos de IA: Retos de codificación interactivos y reales que enseñan específicamente a los desarrolladores a encontrar y corregir vulnerabilidades en el código generado por IA.

- Aprendizaje dirigido: Rutas de aprendizaje seleccionadas a partir de más de 200 desafíos, directrices, recorridos, Missions, misiones y Courses de IA que refuerzan los principios de codificación segura y ayudan a los desarrolladores a dominar las habilidades de seguridad necesarias para mitigar los riesgos de la IA.

Combinando la potente gobernanza de Trust Agent: AI con el desarrollo de habilidades de nuestro producto de aprendizaje, puede crear un SDLC verdaderamente seguro. Podrá identificar riesgos, aplicar políticas y capacitar a sus desarrolladores para crear código de forma más rápida y segura que nunca.

¿Listo para asegurar su viaje a la IA?

La era de la IA ya está aquí y, como responsable de producto, mi objetivo es crear soluciones que no sólo resuelvan los problemas de hoy, sino que se anticipen a los de mañana. Trust Agent: AI está diseñado para hacer precisamente eso, dándole la visibilidad y el control para gestionar los riesgos de la IA al tiempo que permite a sus equipos innovar. La versión beta de acceso anticipado ya está disponible y nos encantaría que participara en ella. No se trata solo de un nuevo producto, sino de ser pioneros en un nuevo estándar para el desarrollo seguro de software en un mundo en el que prima la IA.

Únase hoy mismo a la lista de espera de acceso anticipado.

Descubra cómo Trust Agent: AI proporciona una gran visibilidad y control sobre el código generado por IA, lo que permite a las organizaciones innovar de forma más rápida y segura.

Secure Code Warrior le ayuda a proteger el código a lo largo de todo el ciclo de vida del desarrollo de software y a crear una cultura que dé prioridad a la ciberseguridad. Tanto si es gestor de seguridad de aplicaciones, desarrollador, CISO o responsable de seguridad, le ayudamos a reducir los riesgos asociados al código inseguro.

Reservar una demostraciónSecure Code Warriorの製品管理担当ディレクターであるTamim Noorzadは、エンジニアからプロダクトマネージャーに転向し、17年以上の経験を持ち、SaaS 0対1製品を専門としています。

La adopción generalizada de herramientas de codificación de IA está transformando el desarrollo de software. El 78 % de los desarrolladores1 utilizan ya la IA para aumentar la productividad, por lo que la velocidad de la innovación nunca ha sido mayor. Pero esta rápida aceleración conlleva un riesgo crítico.

Los estudios revelan que hasta el 50% del código funcionalmente correcto generado por IA es inseguro2. No se trata de un pequeño fallo, sino de un reto sistémico. Significa que cada vez que un desarrollador utiliza una herramienta como GitHub Copilot o ChatGPT, podría estar introduciendo sin saberlo nuevas vulnerabilidades en su código base. El resultado es una peligrosa mezcla de velocidad y riesgos de seguridad que la mayoría de las organizaciones no están preparadas para gestionar.

El reto de la "IA en la sombra

Sin una forma de gestionar el uso de herramientas de codificación de IA, los responsables de CISO, AppSec e ingeniería están expuestos a nuevos riesgos que no pueden ver ni medir. Cómo puede responder a preguntas cruciales como:

- ¿Qué porcentaje de nuestro código está generado por IA?

- ¿Qué MCP se están utilizando?

- ¿Qué modelos no aprobados se están utilizando?

- ¿Qué vulnerabilidades generan los distintos modelos?

La falta de visibilidad y gobernanza crea una nueva capa de riesgo e incertidumbre. Es la definición misma de "TI en la sombra", pero para su código base.

Nuestra solución - Trust Agent: AI

Creemos que se puede tener velocidad y seguridad a la vez. Estamos orgullosos de lanzar Trust Agent: AIuna nueva y potente capacidad de nuestro producto Trust Agent que proporciona la capacidad de observación y el control que necesita para adoptar con confianza la IA en su ciclo de vida de desarrollo de software. Mediante una combinación única de señales, Trust Agent: AI proporciona:

- Visibilidad: Vea qué desarrolladores están utilizando qué herramientas de codificación de IA, LLM y MCP, y en qué bases de código. Se acabó la «IA en la sombra».

- Métricas de riesgo: Conecte el código generado por IA con el nivel de conocimientos de un desarrollador y las vulnerabilidades introducidas para comprender el verdadero riesgo que se está introduciendo, a nivel de commit.

- Gobernanza: Automatice la aplicación de políticas para garantizar que los desarrolladores habilitados para IA cumplan las normas de codificación segura.

El panel Trust Agent: AI proporciona información sobre el uso de la herramienta de codificación de IA, el desarrollador que contribuye, el repositorio de código y mucho más.

El papel del desarrollador: La última línea de defensa

Aunque Trust Agent: AI le ofrece una gobernanza sin precedentes, sabemos que el desarrollador sigue siendo la última y más crítica línea de defensa. La forma más eficaz de gestionar el riesgo del código generado por IA es asegurarse de que sus desarrolladores cuentan con los conocimientos de seguridad necesarios para revisar, validar y proteger dicho código. Aquí es donde entra en juego SCW Learning, que forma parte de nuestra plataforma integral de gestión de riesgos para desarrolladores. Con SCW Learning, equipamos a sus desarrolladores con las habilidades prácticas que necesitan para aprovechar de forma segura la IA para la productividad. El producto SCW Learning incluye:

- Puntuación de confianza SCW: Una referencia pionera en el sector que cuantifica la competencia en seguridad de los desarrolladores, lo que le permite identificar qué desarrolladores están mejor equipados para manejar código generado por IA.

- Desafíos de IA: Retos de codificación interactivos y reales que enseñan específicamente a los desarrolladores a encontrar y corregir vulnerabilidades en el código generado por IA.

- Aprendizaje dirigido: Rutas de aprendizaje seleccionadas a partir de más de 200 desafíos, directrices, recorridos, Missions, misiones y Courses de IA que refuerzan los principios de codificación segura y ayudan a los desarrolladores a dominar las habilidades de seguridad necesarias para mitigar los riesgos de la IA.

Combinando la potente gobernanza de Trust Agent: AI con el desarrollo de habilidades de nuestro producto de aprendizaje, puede crear un SDLC verdaderamente seguro. Podrá identificar riesgos, aplicar políticas y capacitar a sus desarrolladores para crear código de forma más rápida y segura que nunca.

¿Listo para asegurar su viaje a la IA?

La era de la IA ya está aquí y, como responsable de producto, mi objetivo es crear soluciones que no sólo resuelvan los problemas de hoy, sino que se anticipen a los de mañana. Trust Agent: AI está diseñado para hacer precisamente eso, dándole la visibilidad y el control para gestionar los riesgos de la IA al tiempo que permite a sus equipos innovar. La versión beta de acceso anticipado ya está disponible y nos encantaría que participara en ella. No se trata solo de un nuevo producto, sino de ser pioneros en un nuevo estándar para el desarrollo seguro de software en un mundo en el que prima la IA.

Únase hoy mismo a la lista de espera de acceso anticipado.

La adopción generalizada de herramientas de codificación de IA está transformando el desarrollo de software. El 78 % de los desarrolladores1 utilizan ya la IA para aumentar la productividad, por lo que la velocidad de la innovación nunca ha sido mayor. Pero esta rápida aceleración conlleva un riesgo crítico.

Los estudios revelan que hasta el 50% del código funcionalmente correcto generado por IA es inseguro2. No se trata de un pequeño fallo, sino de un reto sistémico. Significa que cada vez que un desarrollador utiliza una herramienta como GitHub Copilot o ChatGPT, podría estar introduciendo sin saberlo nuevas vulnerabilidades en su código base. El resultado es una peligrosa mezcla de velocidad y riesgos de seguridad que la mayoría de las organizaciones no están preparadas para gestionar.

El reto de la "IA en la sombra

Sin una forma de gestionar el uso de herramientas de codificación de IA, los responsables de CISO, AppSec e ingeniería están expuestos a nuevos riesgos que no pueden ver ni medir. Cómo puede responder a preguntas cruciales como:

- ¿Qué porcentaje de nuestro código está generado por IA?

- ¿Qué MCP se están utilizando?

- ¿Qué modelos no aprobados se están utilizando?

- ¿Qué vulnerabilidades generan los distintos modelos?

La falta de visibilidad y gobernanza crea una nueva capa de riesgo e incertidumbre. Es la definición misma de "TI en la sombra", pero para su código base.

Nuestra solución - Trust Agent: AI

Creemos que se puede tener velocidad y seguridad a la vez. Estamos orgullosos de lanzar Trust Agent: AIuna nueva y potente capacidad de nuestro producto Trust Agent que proporciona la capacidad de observación y el control que necesita para adoptar con confianza la IA en su ciclo de vida de desarrollo de software. Mediante una combinación única de señales, Trust Agent: AI proporciona:

- Visibilidad: Vea qué desarrolladores están utilizando qué herramientas de codificación de IA, LLM y MCP, y en qué bases de código. Se acabó la «IA en la sombra».

- Métricas de riesgo: Conecte el código generado por IA con el nivel de conocimientos de un desarrollador y las vulnerabilidades introducidas para comprender el verdadero riesgo que se está introduciendo, a nivel de commit.

- Gobernanza: Automatice la aplicación de políticas para garantizar que los desarrolladores habilitados para IA cumplan las normas de codificación segura.

El panel Trust Agent: AI proporciona información sobre el uso de la herramienta de codificación de IA, el desarrollador que contribuye, el repositorio de código y mucho más.

El papel del desarrollador: La última línea de defensa

Aunque Trust Agent: AI le ofrece una gobernanza sin precedentes, sabemos que el desarrollador sigue siendo la última y más crítica línea de defensa. La forma más eficaz de gestionar el riesgo del código generado por IA es asegurarse de que sus desarrolladores cuentan con los conocimientos de seguridad necesarios para revisar, validar y proteger dicho código. Aquí es donde entra en juego SCW Learning, que forma parte de nuestra plataforma integral de gestión de riesgos para desarrolladores. Con SCW Learning, equipamos a sus desarrolladores con las habilidades prácticas que necesitan para aprovechar de forma segura la IA para la productividad. El producto SCW Learning incluye:

- Puntuación de confianza SCW: Una referencia pionera en el sector que cuantifica la competencia en seguridad de los desarrolladores, lo que le permite identificar qué desarrolladores están mejor equipados para manejar código generado por IA.

- Desafíos de IA: Retos de codificación interactivos y reales que enseñan específicamente a los desarrolladores a encontrar y corregir vulnerabilidades en el código generado por IA.

- Aprendizaje dirigido: Rutas de aprendizaje seleccionadas a partir de más de 200 desafíos, directrices, recorridos, Missions, misiones y Courses de IA que refuerzan los principios de codificación segura y ayudan a los desarrolladores a dominar las habilidades de seguridad necesarias para mitigar los riesgos de la IA.

Combinando la potente gobernanza de Trust Agent: AI con el desarrollo de habilidades de nuestro producto de aprendizaje, puede crear un SDLC verdaderamente seguro. Podrá identificar riesgos, aplicar políticas y capacitar a sus desarrolladores para crear código de forma más rápida y segura que nunca.

¿Listo para asegurar su viaje a la IA?

La era de la IA ya está aquí y, como responsable de producto, mi objetivo es crear soluciones que no sólo resuelvan los problemas de hoy, sino que se anticipen a los de mañana. Trust Agent: AI está diseñado para hacer precisamente eso, dándole la visibilidad y el control para gestionar los riesgos de la IA al tiempo que permite a sus equipos innovar. La versión beta de acceso anticipado ya está disponible y nos encantaría que participara en ella. No se trata solo de un nuevo producto, sino de ser pioneros en un nuevo estándar para el desarrollo seguro de software en un mundo en el que prima la IA.

Únase hoy mismo a la lista de espera de acceso anticipado.

Haga clic en el siguiente enlace para descargar el PDF de este recurso.

Secure Code Warrior le ayuda a proteger el código a lo largo de todo el ciclo de vida del desarrollo de software y a crear una cultura que dé prioridad a la ciberseguridad. Tanto si es gestor de seguridad de aplicaciones, desarrollador, CISO o responsable de seguridad, le ayudamos a reducir los riesgos asociados al código inseguro.

Mostrar informeReservar una demostraciónSecure Code Warriorの製品管理担当ディレクターであるTamim Noorzadは、エンジニアからプロダクトマネージャーに転向し、17年以上の経験を持ち、SaaS 0対1製品を専門としています。

La adopción generalizada de herramientas de codificación de IA está transformando el desarrollo de software. El 78 % de los desarrolladores1 utilizan ya la IA para aumentar la productividad, por lo que la velocidad de la innovación nunca ha sido mayor. Pero esta rápida aceleración conlleva un riesgo crítico.

Los estudios revelan que hasta el 50% del código funcionalmente correcto generado por IA es inseguro2. No se trata de un pequeño fallo, sino de un reto sistémico. Significa que cada vez que un desarrollador utiliza una herramienta como GitHub Copilot o ChatGPT, podría estar introduciendo sin saberlo nuevas vulnerabilidades en su código base. El resultado es una peligrosa mezcla de velocidad y riesgos de seguridad que la mayoría de las organizaciones no están preparadas para gestionar.

El reto de la "IA en la sombra

Sin una forma de gestionar el uso de herramientas de codificación de IA, los responsables de CISO, AppSec e ingeniería están expuestos a nuevos riesgos que no pueden ver ni medir. Cómo puede responder a preguntas cruciales como:

- ¿Qué porcentaje de nuestro código está generado por IA?

- ¿Qué MCP se están utilizando?

- ¿Qué modelos no aprobados se están utilizando?

- ¿Qué vulnerabilidades generan los distintos modelos?

La falta de visibilidad y gobernanza crea una nueva capa de riesgo e incertidumbre. Es la definición misma de "TI en la sombra", pero para su código base.

Nuestra solución - Trust Agent: AI

Creemos que se puede tener velocidad y seguridad a la vez. Estamos orgullosos de lanzar Trust Agent: AIuna nueva y potente capacidad de nuestro producto Trust Agent que proporciona la capacidad de observación y el control que necesita para adoptar con confianza la IA en su ciclo de vida de desarrollo de software. Mediante una combinación única de señales, Trust Agent: AI proporciona:

- Visibilidad: Vea qué desarrolladores están utilizando qué herramientas de codificación de IA, LLM y MCP, y en qué bases de código. Se acabó la «IA en la sombra».

- Métricas de riesgo: Conecte el código generado por IA con el nivel de conocimientos de un desarrollador y las vulnerabilidades introducidas para comprender el verdadero riesgo que se está introduciendo, a nivel de commit.

- Gobernanza: Automatice la aplicación de políticas para garantizar que los desarrolladores habilitados para IA cumplan las normas de codificación segura.

El panel Trust Agent: AI proporciona información sobre el uso de la herramienta de codificación de IA, el desarrollador que contribuye, el repositorio de código y mucho más.

El papel del desarrollador: La última línea de defensa

Aunque Trust Agent: AI le ofrece una gobernanza sin precedentes, sabemos que el desarrollador sigue siendo la última y más crítica línea de defensa. La forma más eficaz de gestionar el riesgo del código generado por IA es asegurarse de que sus desarrolladores cuentan con los conocimientos de seguridad necesarios para revisar, validar y proteger dicho código. Aquí es donde entra en juego SCW Learning, que forma parte de nuestra plataforma integral de gestión de riesgos para desarrolladores. Con SCW Learning, equipamos a sus desarrolladores con las habilidades prácticas que necesitan para aprovechar de forma segura la IA para la productividad. El producto SCW Learning incluye:

- Puntuación de confianza SCW: Una referencia pionera en el sector que cuantifica la competencia en seguridad de los desarrolladores, lo que le permite identificar qué desarrolladores están mejor equipados para manejar código generado por IA.

- Desafíos de IA: Retos de codificación interactivos y reales que enseñan específicamente a los desarrolladores a encontrar y corregir vulnerabilidades en el código generado por IA.

- Aprendizaje dirigido: Rutas de aprendizaje seleccionadas a partir de más de 200 desafíos, directrices, recorridos, Missions, misiones y Courses de IA que refuerzan los principios de codificación segura y ayudan a los desarrolladores a dominar las habilidades de seguridad necesarias para mitigar los riesgos de la IA.

Combinando la potente gobernanza de Trust Agent: AI con el desarrollo de habilidades de nuestro producto de aprendizaje, puede crear un SDLC verdaderamente seguro. Podrá identificar riesgos, aplicar políticas y capacitar a sus desarrolladores para crear código de forma más rápida y segura que nunca.

¿Listo para asegurar su viaje a la IA?

La era de la IA ya está aquí y, como responsable de producto, mi objetivo es crear soluciones que no sólo resuelvan los problemas de hoy, sino que se anticipen a los de mañana. Trust Agent: AI está diseñado para hacer precisamente eso, dándole la visibilidad y el control para gestionar los riesgos de la IA al tiempo que permite a sus equipos innovar. La versión beta de acceso anticipado ya está disponible y nos encantaría que participara en ella. No se trata solo de un nuevo producto, sino de ser pioneros en un nuevo estándar para el desarrollo seguro de software en un mundo en el que prima la IA.

Únase hoy mismo a la lista de espera de acceso anticipado.

Índice

Secure Code Warrior le ayuda a proteger el código a lo largo de todo el ciclo de vida del desarrollo de software y a crear una cultura que dé prioridad a la ciberseguridad. Tanto si es gestor de seguridad de aplicaciones, desarrollador, CISO o responsable de seguridad, le ayudamos a reducir los riesgos asociados al código inseguro.

Reservar una demostración[Descargar]Recursos para empezar

Temas y contenidos de la formación en código seguro

Nuestro contenido, líder en el sector, evoluciona constantemente para adaptarse al entorno de desarrollo de software en constante cambio, teniendo siempre en cuenta las funciones de nuestros clientes. Abarca todo tipo de temas, desde la inteligencia artificial hasta la inyección de XQuery, y está diseñado para satisfacer las necesidades de diversos perfiles, desde arquitectos e ingenieros hasta gestores de productos y responsables de control de calidad. Echemos un vistazo al contenido que ofrece nuestro catálogo, clasificado por temas y funciones.

La Cámara de Comercio establece el estándar para la seguridad impulsada por desarrolladores a gran escala

Kamer van Koophandel comparte cómo ha integrado la codificación segura en el desarrollo diario mediante certificaciones basadas en roles, evaluaciones comparativas de Trust Score y una cultura de responsabilidad compartida en materia de seguridad.

Modelado de amenazas con IA: convertir a cada desarrollador en un modelador de amenazas

Saldrá mejor equipado para ayudar a los desarrolladores a combinar ideas y técnicas de modelado de amenazas con las herramientas de IA que ya utilizan para reforzar la seguridad, mejorar la colaboración y crear software más resistente desde el principio.

Recursos para empezar

Cybermon ha vuelto: la misión de IA para derrotar al jefe ya está disponible bajo demanda.

Ahora se puede jugar a «Cybermon 2025 Beat the Boss» en SCW durante todo el año. Introduzca retos de seguridad avanzados de IA/LLM y refuerce a gran escala el desarrollo seguro de la IA.

Explicación de la Ley de Resiliencia Cibernética: su significado para el desarrollo de software seguro desde el diseño

Descubra qué exige la Ley de Resiliencia Cibernética (CRA) de la UE, a quién se aplica y cómo puede prepararse el equipo de ingeniería para las prácticas de seguridad desde el diseño, la prevención de vulnerabilidades y el desarrollo de las capacidades de los desarrolladores.

Enable 1: Criterios de éxito predefinidos y medibles

Enabler 1 es la primera parte de la serie Enablers of Success, compuesta por diez partes, y presenta cómo madurar un programa a largo plazo vinculando la codificación segura con resultados empresariales como la reducción de riesgos y la velocidad.

.avif)

%20(1).avif)

.avif)