Incorporar seguridad en el código para reducir los riesgos de red.

Incorporar seguridad en el código para reducir los riesgos de red.

Además de la formación de los desarrolladores, también es necesario integrar la mentalidad de seguridad en todo el proceso de desarrollo mediante el aprendizaje práctico relevante, con el fin de reducir los riesgos.

Mejorar las habilidades de desarrollo seguro en el nuevo mundo de la inteligencia artificial

Secure Code Warrior apoya la transición de las empresas hacia prácticas de desarrollo asistidas por IA mediante programas de mejora de habilidades altamente relevantes. Estas iniciativas están diseñadas para abordar diversas deficiencias, desde la falta de conocimiento sobre el uso de la IA y los LLM, hasta la confianza excesiva en la seguridad del código generado por IA y la aparición de nuevas vulnerabilidades relacionadas con la codificación basada en IA.

Obtenga contenido de primera clase sobre temas relacionados con la IA/LLM que abarca los distintos roles a lo largo del ciclo de vida del desarrollo de software (SDLC) para reducir los riesgos. Desde desarrolladores y personal de control de calidad hasta arquitectos y gestores de productos, tenemos lo que necesita.

Desarrollo de software de seguridad de próxima generación

Reducir los riesgos en el mundo de la IA y los desarrolladores

Con la generación de más líneas de código a mayor velocidad y menos revisiones, el riesgo de ocultar vulnerabilidades, fallos de seguridad y deuda técnica crece exponencialmente. Este cambio hace que las prácticas de revisión de código, pruebas y codificación segura sean más importantes que nunca, para garantizar que la velocidad no se logre a costa de la fiabilidad y la seguridad. Mejorar las habilidades de los desarrolladores en entornos como Github Copilot, Cursor AI,Amazon Q y otras herramientas, mejorar las habilidades de los desarrolladores es el primer paso para obtener mejores resultados, lo que pone de relieve la necesidad de seguir prestando atención a la formación en código seguro.

Explorar el contenido de la plataforma de aprendizaje

Utilizar la observabilidad y la gobernanza para gestionar los riesgos de la IA.

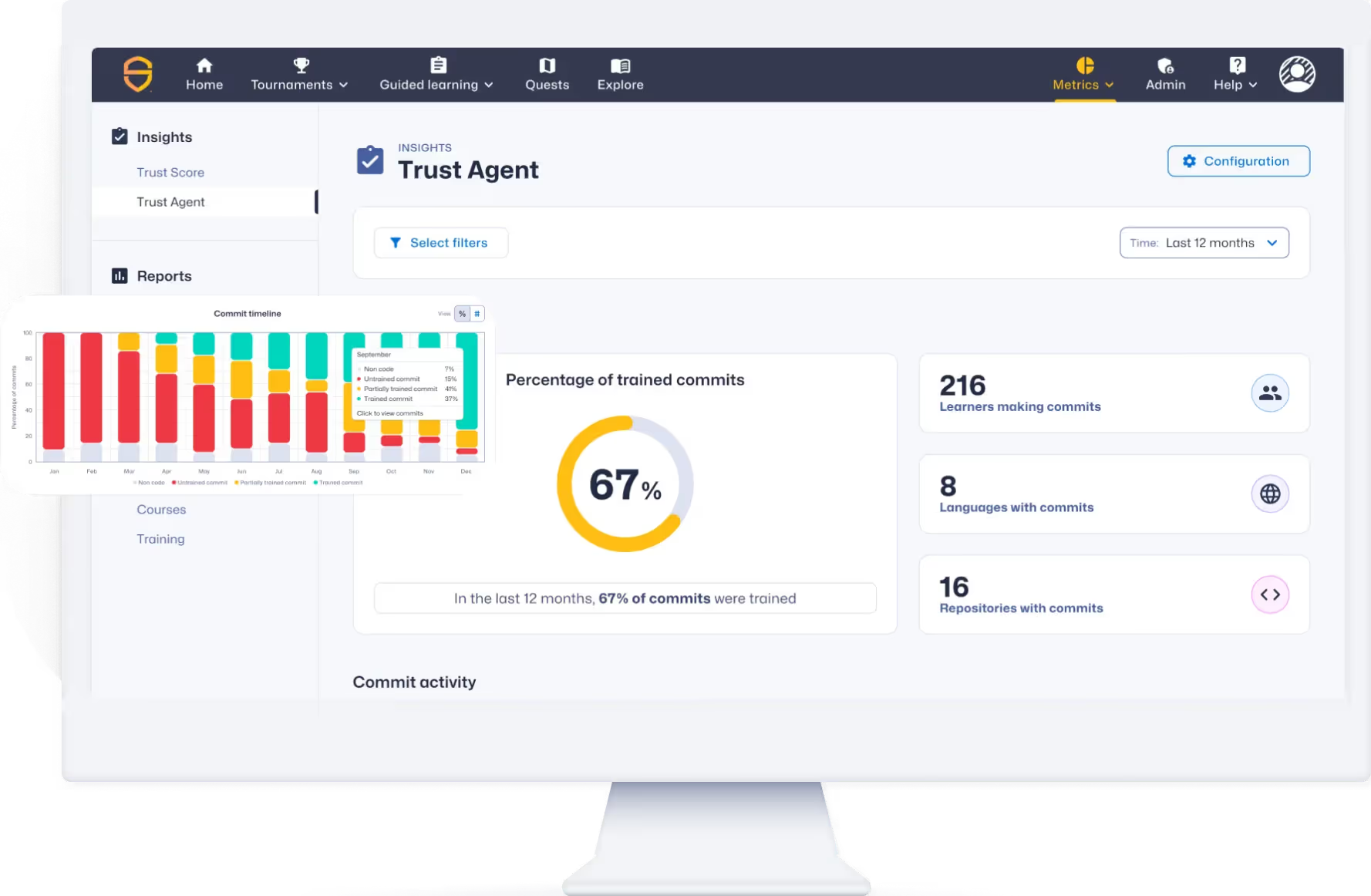

El plan de habilidades es solo el primer paso para garantizar que esté preparado para los riesgos adicionales que conlleva la codificación asistida por IA. SCW Trust Agent™ le permite conocer a los desarrolladores que utilizan su repositorio de código y obtener información detallada sobre sus habilidades en materia de seguridad. A continuación, puede configurar políticas para el repositorio de código y ayudar a mejorar la seguridad mediante una gestión proactiva.

Explora SCW Trust AgentImpacto medible más allá del cumplimiento normativo

Las organizaciones que adoptan un enfoque proactivo para proteger el código más allá de las mejores prácticas de cumplimiento verán resultados empresariales tangibles. Porque la forma más rentable de resolver las vulnerabilidades es prevenirlas desde el principio. SCW Trust Score™ ofrece a las organizaciones una forma de medir y comparar el progreso de las habilidades de seguridad de los desarrolladores a lo largo del tiempo, lo cual es especialmente importante para realizar un seguimiento de estos avances en las primeras etapas de la adopción de entornos de codificación impulsados por la inteligencia artificial.

Explora la puntuación de confianza de SCW

Utilice reglas de seguridad gratuitas para generar código de IA más seguro.

Las herramientas de codificación con IA son muy rápidas, pero no siempre seguras. Las reglas de seguridad de inteligencia artificial gratuitas de Secure Code Warrior proporcionan una protección sencilla y ligera que ayuda a herramientas como Copilot y Cursor a generar código más seguro de forma predeterminada. Fáciles de adoptar, ampliar e integrar en su configuración, sin necesidad de tener una cuenta SCW.

Explorar las reglas de seguridad de la IAAumenta la productividad, pero aumenta el riesgo.

La adopción generalizada de herramientas de programación de inteligencia artificial plantea nuevos retos: la falta de visibilidad y gobernanza del código generado por la inteligencia artificial.

78%

- Desbordamiento de pila

30%

-arXiv

50%

-baxBench

Las ventajas de confiar en los agentes: inteligencia artificial

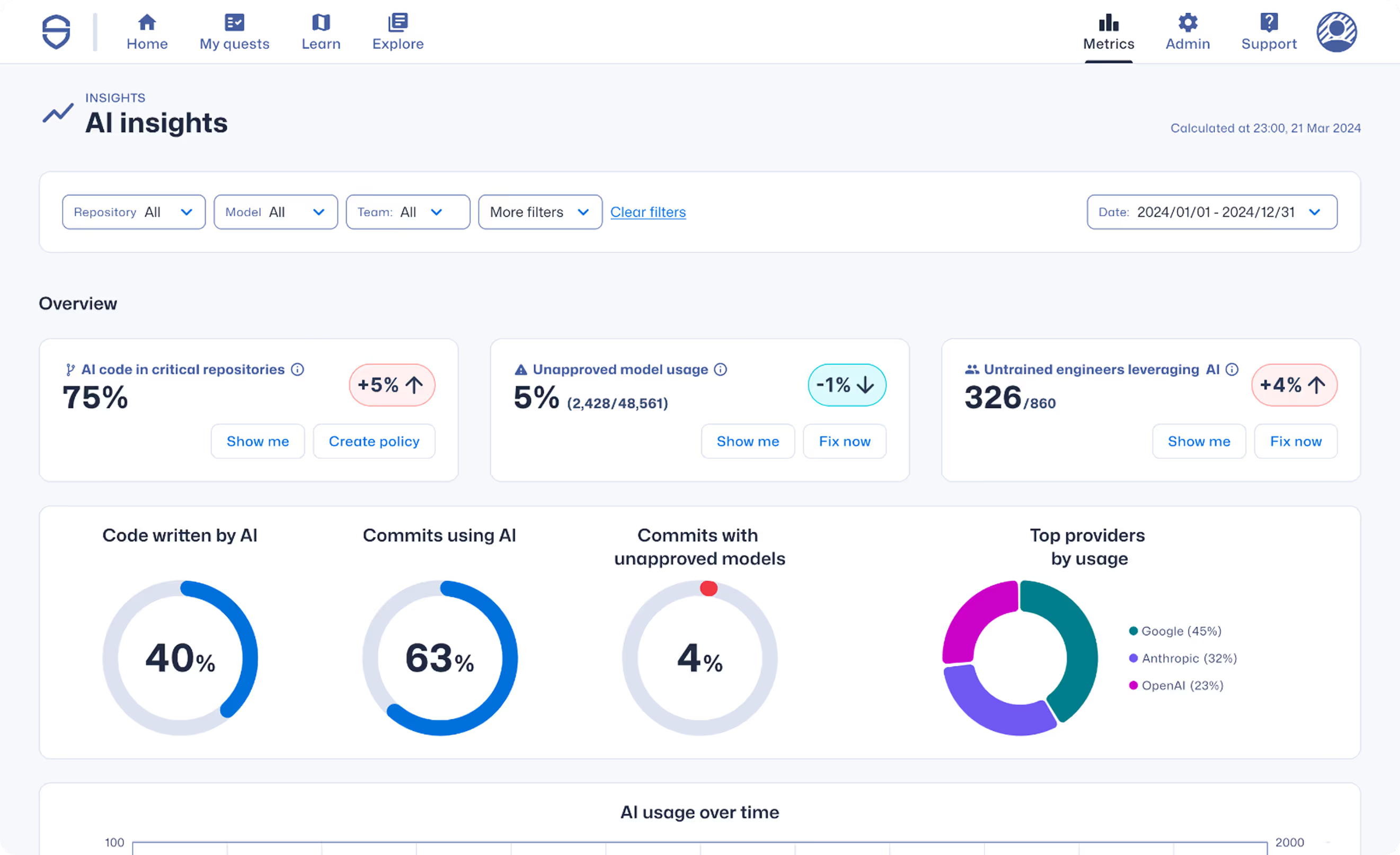

La nueva función de IA de SCW Trust Agent proporciona la observabilidad y el control necesarios para gestionar con confianza la adopción de la IA en el ciclo de vida del desarrollo de software (SDLC) sin sacrificar la seguridad.

Los retos de la IA en el SDLC

Si no se gestiona el uso de la inteligencia artificial, los responsables de seguridad de la información, AppSec y los líderes de ingeniería se enfrentarán a nuevos riesgos y problemas que no podrán resolver. Algunos de estos problemas son: la falta de visibilidad sobre qué desarrolladores están utilizando modelos no autorizados; la incertidumbre sobre las capacidades de seguridad de los desarrolladores que utilizan inteligencia artificial; el desconocimiento del porcentaje de código aportado que ha sido generado por inteligencia artificial; y la imposibilidad de aplicar políticas y medidas de gobernanza para gestionar los riesgos de las herramientas de IA.

- Falta de visibilidad sobre qué desarrolladores están utilizando modelos no autorizados.

- Existe incertidumbre sobre la capacidad de seguridad de los desarrolladores que utilizan inteligencia artificial.

- No está claro qué porcentaje del código es generado por inteligencia artificial.

- No se pueden aplicar políticas ni regulaciones para gestionar los riesgos de las herramientas de IA.

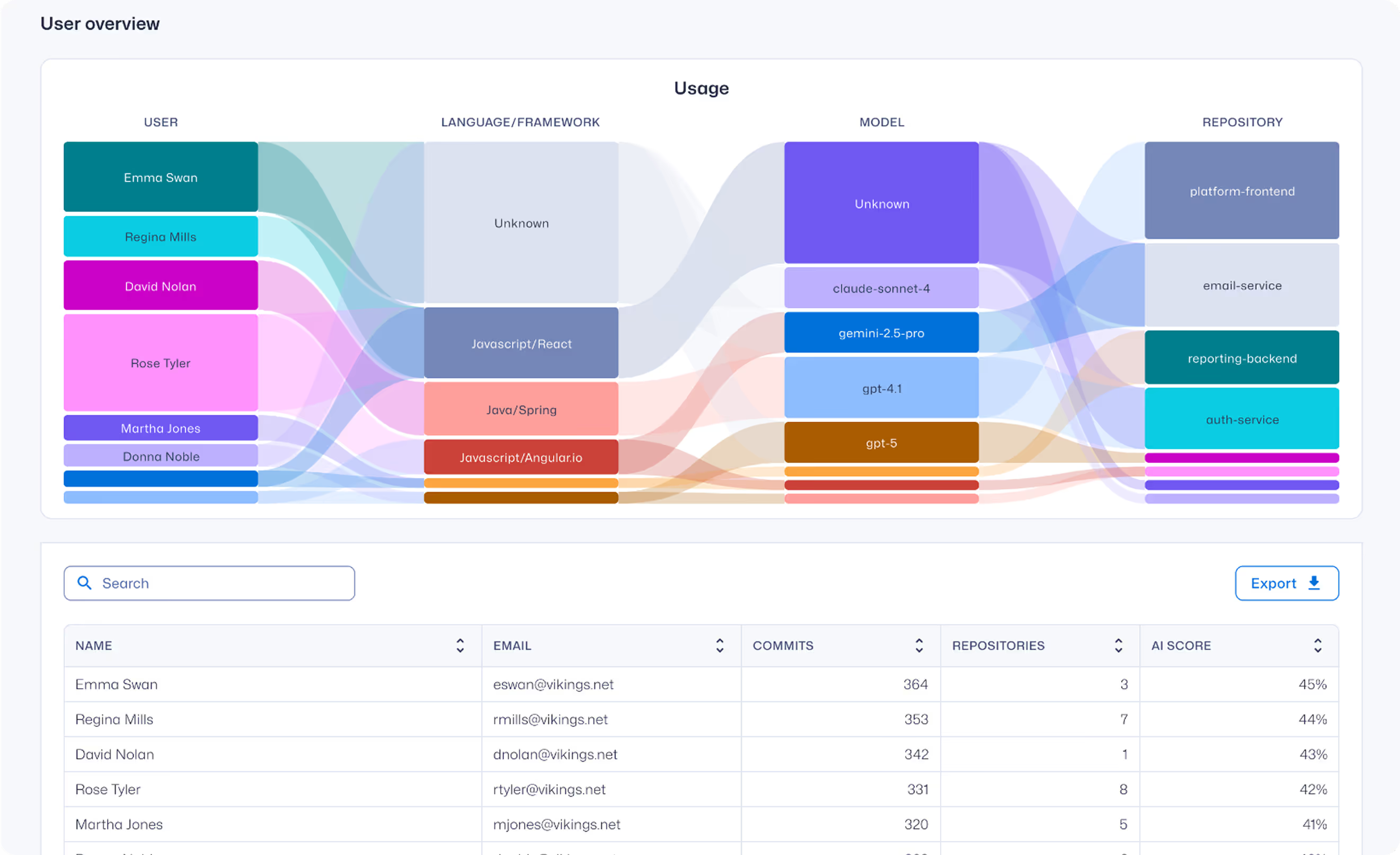

Combinación única de señales

SCW permite a las organizaciones adoptar la velocidad de desarrollo impulsada por la inteligencia artificial sin sacrificar la seguridad. AI Signals es la primera solución que ofrece visibilidad y gobernanza mediante la combinación única de tres señales clave para comprender los riesgos a nivel de entrega de los desarrolladores asistidos por IA.

- Uso de herramientas de codificación de IA: comprensión profunda de quién utiliza qué herramientas de inteligencia artificial y qué LLM se basa en qué repositorios de código.

- Captura en tiempo real: Agente de confianza: la IA intercepta el código generado por la inteligencia artificial en el ordenador y el IDE del desarrollador.

- Habilidades de codificación segura para desarrolladores: Podemos comprender claramente la capacidad de codificación segura de los desarrolladores, que es una habilidad básica necesaria para el uso responsable de la inteligencia artificial.

Visibilidad del uso de la IA

Comprenda completamente los asistentes y agentes de programación de IA, así como los LLM que los respaldan. Descubra herramientas y modelos no autorizados. Se acabó la «IA en la sombra».

Observabilidad de los desarrolladores y repositorios de código para las entregas asistidas por IA

Profundice en el desarrollo de software asistido por inteligencia artificial, incluyendo qué desarrolladores están utilizando qué modelos LLM y en qué repositorios de código se basan.

Gestión y control integrales

Relacionar el código generado por IA con las entregas reales para comprender los riesgos de seguridad reales que se introducen. Aplicar automáticamente las políticas para garantizar que los desarrolladores que utilizan IA cumplan con los estándares de codificación segura antes de que se acepten sus contribuciones.

Explora las perspectivas de la IA

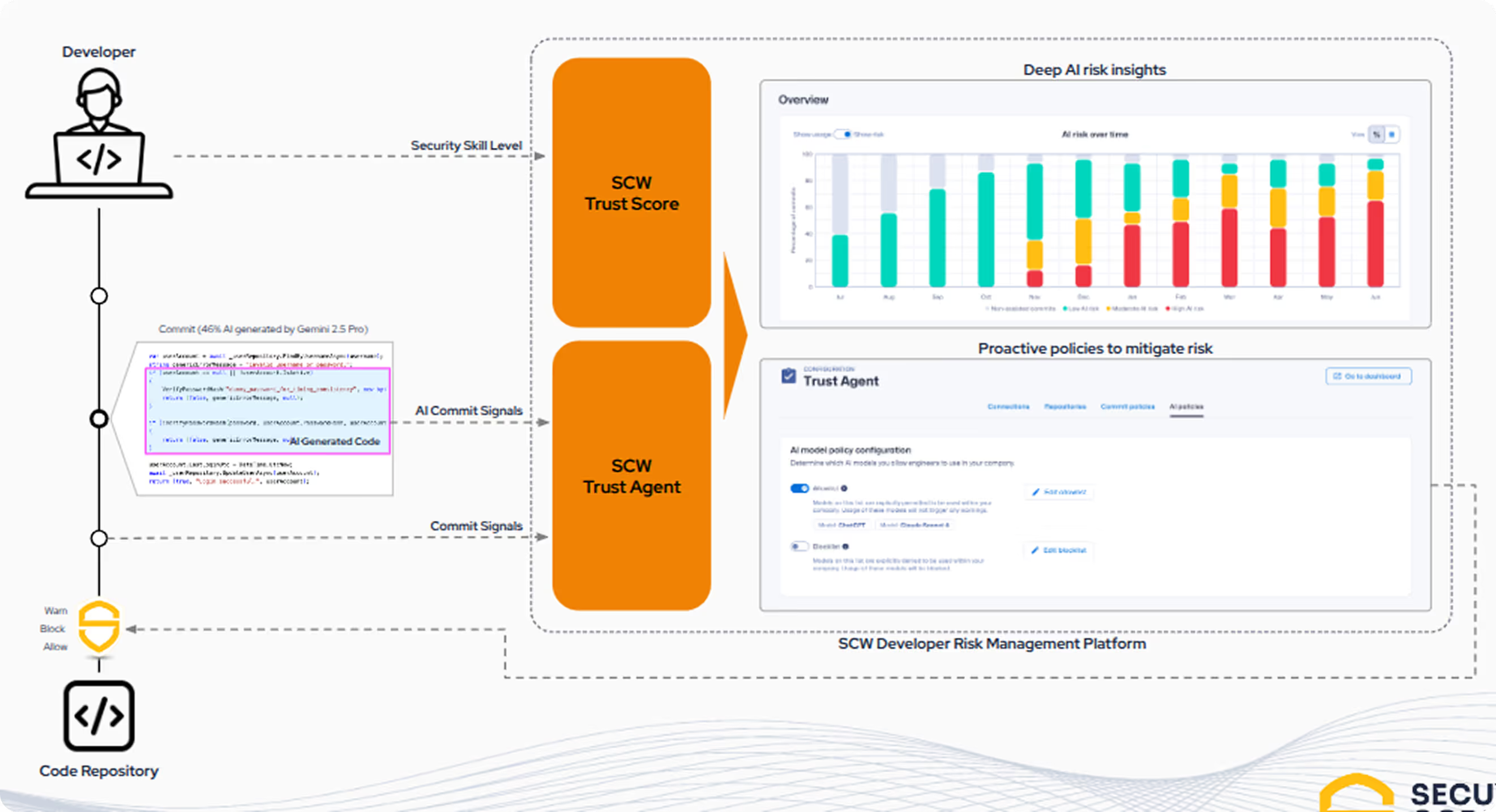

Trust Agent: La inteligencia artificial permite a las empresas comprender los riesgos que conlleva el uso por parte de los desarrolladores de herramientas de generación de código basadas en LLM. La solución lo hace en tres pasos:

- Comprobación del tráfico de código generado por IA: Agente de confianza: la IA se implementa como un simple complemento IDE o agente de punto final para interceptar y supervisar el código generado por herramientas de codificación de IA (como GitHub Copilot, ChatGPT, Google Gemini o Cursor).

- Enriquecer el nivel de habilidades de los desarrolladores: El último paso consiste en utilizar las capacidades de codificación segura de los desarrolladores colaboradores para enriquecer estos datos, capacidades que se miden mediante el producto de aprendizaje de código seguro líder en el sector SCW.

Al correlacionar estas señales clave, Trust Agent: AI proporciona información procesable a los equipos de seguridad e ingeniería, incluyendo el uso no autorizado de modelos LLM e identificando a los desarrolladores con conocimientos limitados de codificación segura pero que están enviando código generado por IA.

Comprender la situación de riesgo de su organización

Cualquier fuga de datos puede dañar la reputación de su marca y provocar que su organización pierda negocios o se enfrente a multas reglamentarias. ¿Sabía que el 67 % de los desarrolladores admite haber publicado deliberadamente código con vulnerabilidades? La plataforma de formación en seguridad para desarrolladores Secure Code Warrior le permite evaluar las habilidades de codificación segura de los desarrolladores, lo que le permite crear planes de formación personalizados diseñados para minimizar el perfil de riesgo de su organización.

Secure Code Warrior ayudarle a mitigar los riesgos de ciberseguridad

Reducir la exposición al riesgo mediante desarrolladores expertos.

- Más de 75 lenguajes de programación y marcos de trabajo.

- Aprender haciendo

- Más de 11 000 actividades de aprendizaje.

Centrarse en el desarrollo seguro también:

降低成本

Aumentar la productividad

Cumplimiento normativo

Reducir los riesgos mediante una visibilidad y un control completos.

- Control de estrategias personalizables

- Amplia compatibilidad con repositorios de código

- Perspectivas prácticas que abarcan repositorios, idiomas y desarrolladores.

Otros códigos de seguridad Warrior

Recursos sobre perspectivas de IA

Otros códigos de seguridad Warrior Recursos relacionados con IA y LLM

Recursos para ayudarle a empezar

Una cultura de la seguridad: cómo Sage creó su programa de campeones de la seguridad con un aprendizaje ágil del código seguro

Descubra cómo Sage mejoró la seguridad con un enfoque flexible y centrado en las relaciones, creando más de 200 campeones de seguridad y logrando una reducción de riesgos cuantificable.

La Cámara de Comercio establece el estándar para la seguridad impulsada por desarrolladores a gran escala

Kamer van Koophandel comparte cómo ha integrado la codificación segura en el desarrollo diario mediante certificaciones basadas en roles, evaluaciones comparativas de Trust Score y una cultura de responsabilidad compartida en materia de seguridad.

Cómo «Code Game» está guiando al Grupo IAG hacia un futuro más seguro en programación

El grupo IAG es el nombre detrás de muchas de las principales aseguradoras de la región Asia-Pacífico, con pólizas que cubren a millones de clientes, por un valor total aproximado de 11 400 millones de dólares australianos en primas anuales.