La IA amplía su cadena de suministro de software.

Los agentes conectados a AI Coding Assistant, LLM y MCP ahora pueden generar código de producción en su repositorio. El ritmo de desarrollo se ha acelerado, pero la gobernanza no ha seguido el ritmo. La inteligencia artificial se ha convertido en un colaborador incontrolado de su cadena de suministro de software.

La mayoría de las organizaciones no pueden responder con claridad:

- ¿Qué modelos de IA generaron envíos específicos?

- ¿Estos modelos generan resultados seguros de forma continua?

- ¿Qué servidores MCP están activos y a qué contenido acceden?

- ¿El envío asistido por inteligencia artificial cumple con los estándares de codificación de seguridad?

- ¿Cómo afecta el uso de la inteligencia artificial al riesgo global del software?

Sin una gobernanza estructurada del software de inteligencia artificial, las organizaciones se enfrentarán a una dispersión de la propiedad, una visibilidad limitada y una exposición cada vez mayor. El desarrollo asistido por inteligencia artificial aumenta la velocidad del código, pero sin una supervisión obligatoria también aumenta el riesgo de introducir vulnerabilidades y los riesgos de la cadena de suministro de los modelos.

Supervisión obligatoria del desarrollo impulsado por la inteligencia artificial.

Permite a las organizaciones:

- Profundizar en el conocimiento de dónde y cómo se utiliza la inteligencia artificial.

- Relacionar la presentación asistida por IA con los riesgos del software.

- Definir y aplicar la política de uso de IA en el momento de la presentación.

- Reforzar la rendición de cuentas en el desarrollo asistido por humanos e inteligencia artificial.

Gestión del ciclo de vida del software de IA

Las herramientas tradicionales de seguridad de aplicaciones detectan vulnerabilidades después de escribir el código. El software de gobernanza de IA aplica políticas, verifica el uso de los modelos de IA y asocia los riesgos, lo que permite prevenir las vulnerabilidades antes de que se implementen en producción.

Herramientas y modelos de IA con trazabilidad

Identificar qué herramientas y modelos de IA afectan al código del repositorio para crear un inventario verificable del uso de la IA.

Detección de sombras mediante IA

Identificar herramientas y modelos de IA no autorizados que operan fuera de los controles de gobernanza aprobados.

LLM Prueba de referencia de seguridad

Evaluar el rendimiento de los modelos de IA según los patrones de vulnerabilidad reales y exigir el uso de modelos aprobados.

Calificación de riesgos y gobernanza a nivel de comité

Relacionar el envío asistido por IA con las señales de riesgo y aplicar políticas ejecutables antes de que el código entre en producción.

Visibilidad del servidor MCP

Identificar los servidores MCP que están en uso y aplicar políticas de nivel de envío a las conexiones no autorizadas.

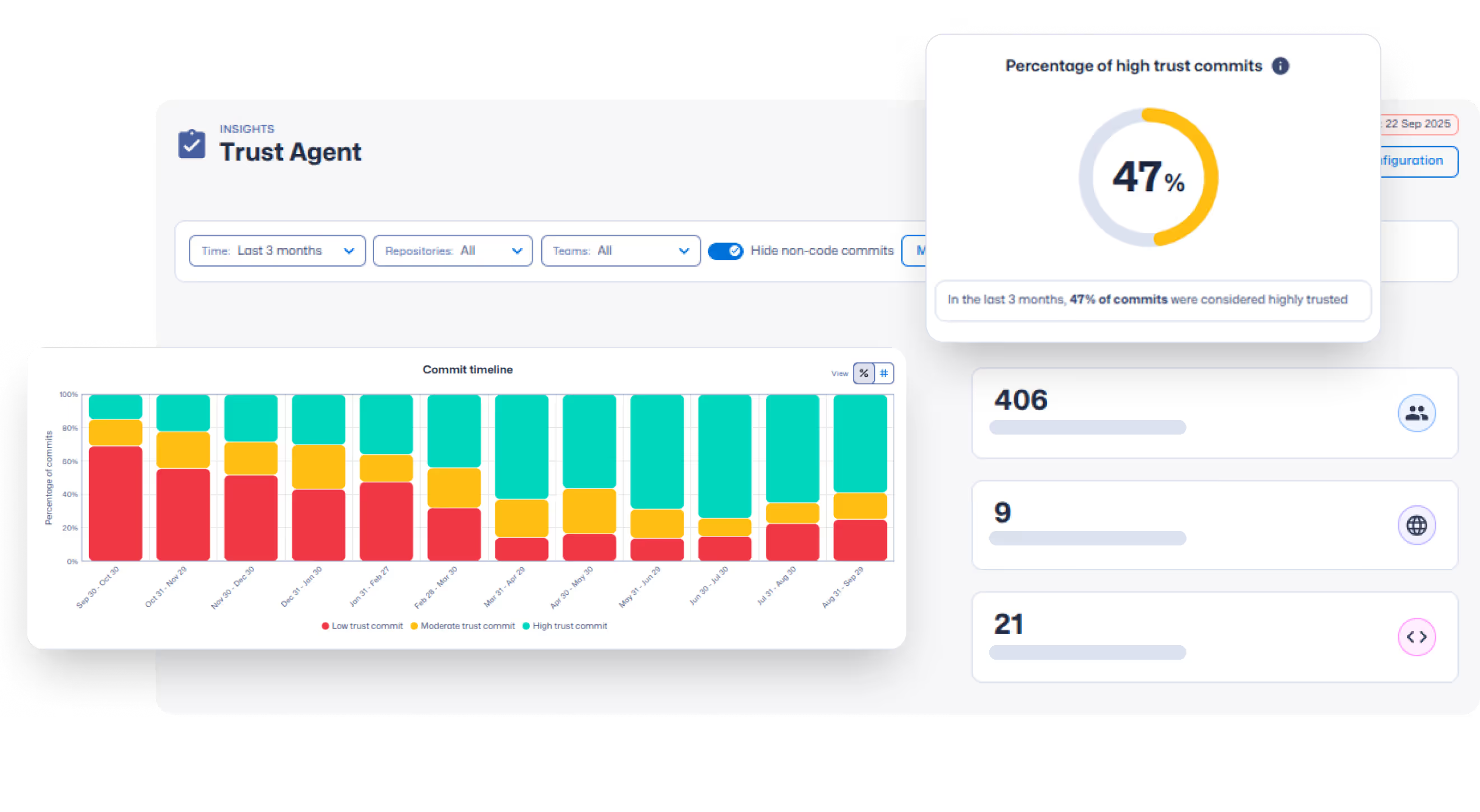

Descubrimiento e inteligencia de desarrolladores

Identificar continuamente a los desarrolladores, las actividades asistidas por inteligencia artificial y los patrones de envío para reforzar la rendición de cuentas y la visibilidad de los riesgos.

Gestionar el desarrollo asistido por IA en cuatro pasos

Conectar y observar

Integración con repositorios y sistemas de CI para supervisar los metadatos de envío, el uso de modelos de IA y la actividad de los colaboradores.

Nuestro público objetivo

Lorem Issum diam quis eim leboutis ein selerisque lobortis sepitis beelrisque lobortis sepitis celerisque lobortis celeriskue filmentis celeriskue filmentis celeriskue diam

Gestionar el desarrollo impulsado por la inteligencia artificial antes de su lanzamiento.

Realizar un seguimiento del uso de modelos de IA. Aplicar las políticas en el momento de la presentación. Mantener el control de la preparación para la auditoría de la cadena de suministro del software de inteligencia artificial.

Control, medición y protección Desarrollo de software asistido por IA

Descubra Secure Code Warrior proporciona observabilidad, ejecución de políticas y gobernanza de la IA Secure Code Warrior los flujos de trabajo de desarrollo asistidos por IA.