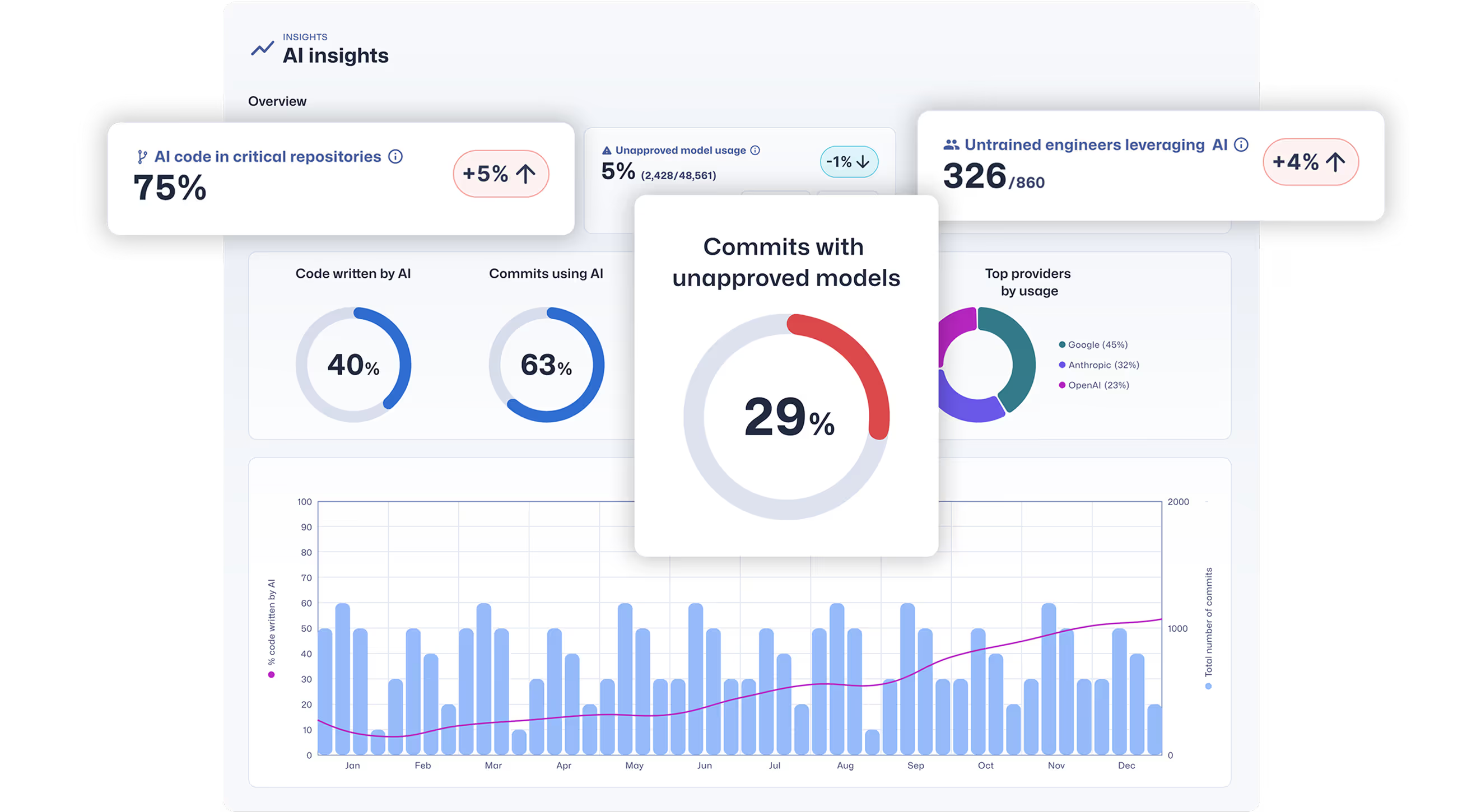

Trust Agent: La IA captura señales de uso de IA y metadatos de confirmación, en lugar de código fuente o indicaciones, lo que protege la información personal de los desarrolladores y, al mismo tiempo, permite una gobernanza a gran escala. Esto permite auditar y gestionar el desarrollo asistido por IA en un ciclo de vida de desarrollo de software (SDLC) seguro, lo que permite gestionar los riesgos de los desarrolladores antes de la producción.

Hace que el desarrollo asistido por IA sea visible, auditable y gestionable en todo el ciclo de vida seguro del desarrollo de software (SDLC), lo que ayuda a las organizaciones a identificar y reducir los riesgos de los desarrolladores antes de que el código llegue a la fase de producción.