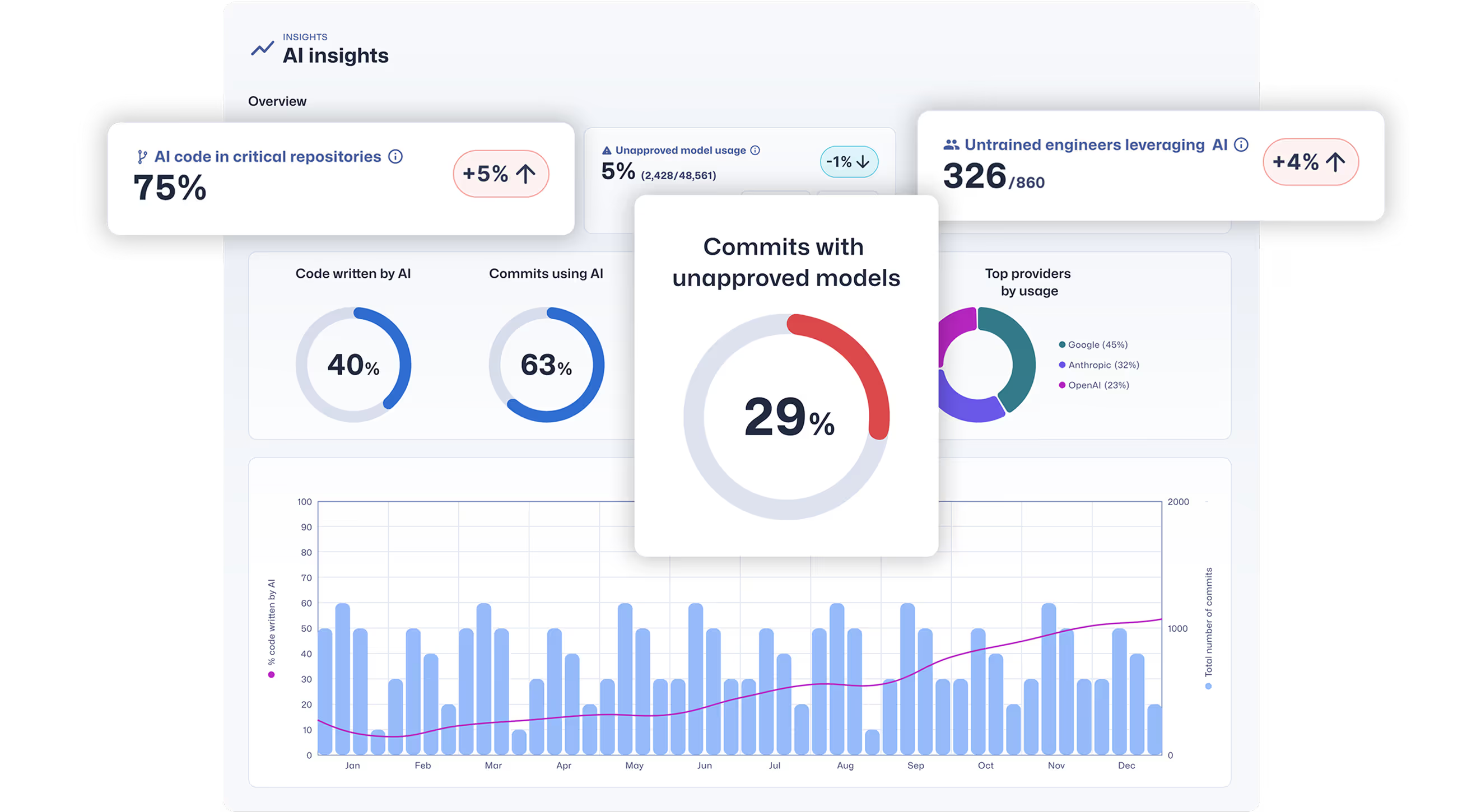

Agente de confianza: la IA captura las señales de uso de la IA y valida los metadatos, no el código fuente ni las instrucciones, al tiempo que preserva la confidencialidad de los desarrolladores y permite una gobernanza a gran escala. Hace que el desarrollo asistido por IA sea auditable y gestionable a través del SDLC seguro, gestionando así los riesgos para los desarrolladores antes de la producción.

Hace que el desarrollo asistido por IA sea visible, auditable y gestionable en todo el ciclo de vida seguro del desarrollo de software (SDLC), lo que ayuda a las organizaciones a identificar y reducir los riesgos de los desarrolladores antes de que el código llegue a la fase de producción.